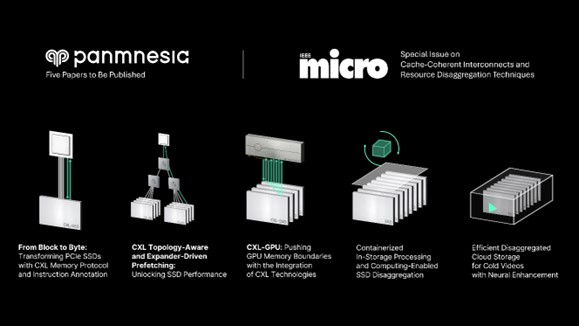

AI 인프라 솔루션 전문기업 파네시아(대표 정명수)는 컴퓨터 아키텍처 관련 국제 유수 저널 IEEE Micro에 총 5편의 논문을 게재했다고 20일 밝혔다.

이번에 채택된 연구결과는 차세대 연결/반도체 기술인 컴퓨트익스프레스링크(CXL) 및 인-스토리지 프로세싱을 적용한 스토리지 솔루션을 다루고 있으며, IEEE Micro 5/6월호를 통해 공개될 예정이다.

IEEE Micro는 1981년에 창간된 컴퓨터 아키텍처 및 반도체 기술 분야의 권위 있는 저널로, 학계 및 산업계 최신 연구 성과를 격월 간행으로 소개하고 있다. 매 호마다 컴퓨팅 및 반도체 기술과 관련된 서로 다른 주제를 다루며, 이번 5/6월호에서는 ‘캐시 일관성 보장 연결 기술 및 자원 분리(Cache Coherent Interconnects and Resource Disaggregation Techniques)’가 특집 주제로 선정됐다. 파네시아는 CXL, 인-스토리지 프로세싱 등 차세대 연결/반도체 기술을 적용한 스토리지 솔루션 관련 논문을 5편 공개하며 존재감을 드러냈다.

파네시아가 공개한 5편의 논문 중 2편의 논문은 ‘CXL-SSD’와 관련된 내용을 중점적으로 다룬다. CXL-SSD는 차세대 고속 연결 기술인 CXL을 적용해 SSD를 메모리처럼 활용하는 기술로, 파네시아 정명수 대표가 2022년 기술문서를 통해 CXL-SSD의 개념과 실질적인 구현방안을 공개 제안한 바 있다. 일반적인 DRAM에 비해 비용 효율이 수십 배 이상 높은 SSD 미디어를 메모리처럼 활용함으로써 메모리 확장 비용을 대폭 낮출 수 있다는 것이 장점이다.

그러나 SSD가 기존 DRAM보다는 속도가 느리다는 한계가 존재했는데 이번 논문에서 파네시아는 이러한 CXL-SSD의 성능을 개선하기 위한 방안을 두 가지 공개했다. 첫 번째 논문에서는 사용자가 각 데이터에 대해 어떻게 처리하는 것이 최적일지에 대해 SSD에게 직접 힌트를 주는 방식을 설명하며, 두 번째 논문에서는 미래에 어떤 데이터가 필요할 지 기계학습을 통해 예측하여 미리 데이터를 준비해두는 방식을 다룬다.

파네시아는 CXL-SSD를 활용해 GPU 메모리를 확장하고, 그래프 신경망(Graph Neural Networks, GNNs)과 같은 대규모 AI 응용을 가속하는 연구 결과도 이번에 함께 발표했다.

최근 AI 서비스가 널리 활용됨에 따라, 기업에서는 더 좋은 성능의 기계학습을 사용자들에게 제공하기 위해 학습에 필요한 데이터 크기를 경쟁적으로 증가시키고 있다. 그 결과 최신 기계학습 서비스들의 메모리 요구량은 수십 테라 바이트에 달하는 등 최신 GPU 장치의 메모리 용량을 크게 넘어서고 있다. 파네시아는 그 대안으로 CXL-SSD를 GPU에 연결해 GPU 메모리 용량을 효율적으로 확장하고, 그래프 신경망과 같은 응용을 가속하는 솔루션에 대해 공개했다.

이번 IEEE Micro 5/6월 호에서는 CXL 뿐만이 아니라 데이터가 저장되는 스토리지 내부에서 직접 연산을 수행하는 ‘인-스토리지 프로세싱 기술’이 적용된 스토리지 솔루션 또한 함께 발표된다.

파네시아는 인-스토리지 프로세싱 기술이 탑재된 연산스토리지 장치를 다수 연결해 연산스토리지 배열/연산스토리지 풀(pool)을 구성하고, 대규모 언어모델(LLM)과 같은 AI 응용 관련 연산을 데이터가 저장된 스토리지 내부에서 직접 수행하는 솔루션을 개발했다.

이번 IEEE Micro에 공개된 기술개발결과 외에도 파네시아는 CXL, NDP(Near Data Processing, 데이터 근처 연산), PIM(Process-In-Memory, 메모리 내부 연산), 칩렛, 온디바이스AI 등의 기술을 활용해 AI 인프라를 개선하기 위한 연구를 활발하게 진행하고 있다. 파네시아의 다양한 연구 개발 결과는 파네시아 홈페이지 및 링크드인, 유튜브 채널을 통해 확인할 수 있다.