엣지에서는 CPU 영향력 발휘 못해… VPU '모비디우스' 등 강조

xPU AI 추론 소프트웨어 개발 도구 'OpenVINO' 등 SW 대거 보강

인텔이 한국에서 처음으로 인공지능(AI)을 다룬 ‘엣지 AI 포럼’을 4일 개최했다.

행사 내내 인텔이 주장한 건 단 하나다. 인텔의 ‘엣지 AI’는 단순 하드웨어가 아니라는 것이다.

컴퓨팅 구조, 집중형에서 분산형으로

컴퓨팅 업계가 엣지(Edge)를 논하기 시작한 건 수년 전부터다. 지금은 인텔을 비롯해 엔비디아·Arm 등 주요 반도체 업체들이 너나할 것 없이 ‘엣지’를 좇는다.

그동안 컴퓨팅 기술은 중심부에서 모든 주변부를 제어하는 방향으로 발전해왔다. 반도체에서는 중앙처리장치(CPU)가, 네트워크 인프라에서는 클라우드(Cloud)가 ‘중앙’의 역할을 했다.

하지만 IT기기 종류·대수가 많아지면서 중앙에서 모든 시스템을 제어하기가 어려워졌고, 중앙이 아닌 가장자리, 엣지의 성능을 높여야한다는 인식이 퍼지기 시작했다.

데이터가 발생하는 곳, 혹은 그 근처에서 단계적으로 이를 처리해 중앙 컴퓨팅 시스템의 부담을 줄이고 보다 빠르게 서비스를 제공해야한다는 것이다.

엣지의 사전적 의미는 ‘가장자리’다. 처음에는 센서 같은 말단 장치가 엣지를 뜻했고, 그 다음에는 모바일 같은 단말기가 엣지 기기가 됐다. 최근에는 엣지의 영역이 말단 장치부터 단말기, 네트워크 인프라의 게이트웨이(Gateway)까지 넓어졌다.

여기에 AI까지 들어왔다. 클라우드에서 AI 데이터를 처리한다고 해도 클라우드와 연결되는 무선 통신망이 없으면 무용지물이다. 엣지 단말 자체에 AI를 넣어야 한다는 얘기다.

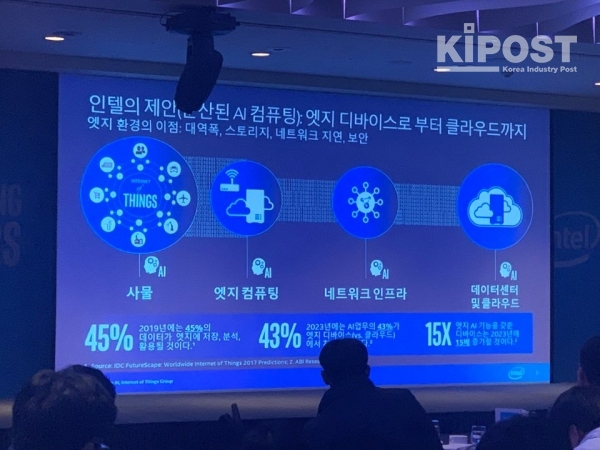

인텔에 따르면 올해 전체 데이터의 45%가 엣지 기기에 저장·분석·활용될 것으로 추정된다. 오는 2023년에는 AI 업무의 43%가 엣지 디바이스에서 처리될 전망이라고 회사는 설명했다. 그 사이 엣지 AI 기기는 15배 증가한다.

하드웨어만으로는 엣지를 장악할 수 없다

인텔은 세계 CPU 시장의 90% 이상을 차지하고 있다. 하지만 엣지에서는 CPU의 영향력이 크지 않다.

말단 장치에는 CPU가 아닌 마이크로프로세서(MPU)·마이크로제어장치(MCU)가 들어가고, 모두 Arm 생태계에 있는 업체들이 장악하고 있다. 스마트폰 또한 퀄컴 천하다. 그나마 네트워크 인프라에 들어가는 엣지 컴퓨팅이 CPU를 쓴다.

그래서 인텔은 전략을 바꿨다.

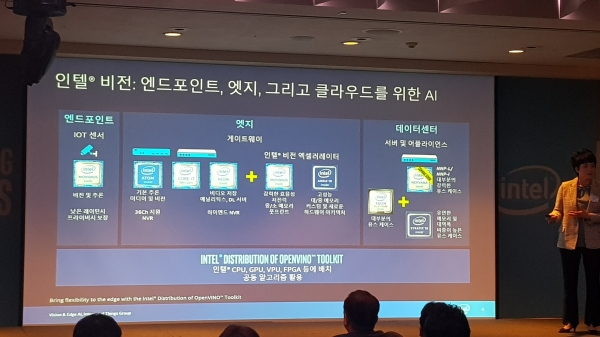

CPU와 함께 비전프로세서(VPU), 가속기를 엣지 AI를 위한 하드웨어 라인업에 추가했다. 엣지부터 클라우드에 이르기까지 각 계층(Level)마다 필요한 소프트웨어 개발 도구도 내놨다. 나이 및 성별 인식, 자동차 식별, 얼굴 검출 등 이미 학습된 딥러닝 모델도 25가지나 제공한다.

메인 하드웨어는 VPU ‘모비디우스(MOVIDIUS)’다.

2세대 모비디우스까지는 주로 AP·MCU 등 프로세서와 같이 쓰여 대부분 데이터 보조 처리 역할에 불과했지만, 내년 출시할 3세대 VPU 모비디우스(코드명 킴베이·KEMM BAY)는 단독으로도 쓸 수 있을 정도로 성능을 높였다. 전력효율성은 엔비디아 ‘젯슨 AGX 자비에’보다 4.7배 높다.

단일 프로세서로도 제공되며 이를 2개 결합해 M.2 폼팩터(Form factor)로, 혹은 4~8개를 집적한 카드 형태로 공급할 수 있다.

최병원 인텔 IoT그룹 상무는 “3세대 모비디우스 VPU는 엣지 AI 블록(Block)과 비전 처리 블록, 미디어 블록, 이미지신호처리장치(ISP) 등으로 구성됐으며 메모리 대역폭도 넓고 아키텍처도 효율적”이라며 “단말부터 시스템까지 다양한 기기에 적용할 수 있도록 폼팩터도 가변적으로 제공된다”고 말했다.

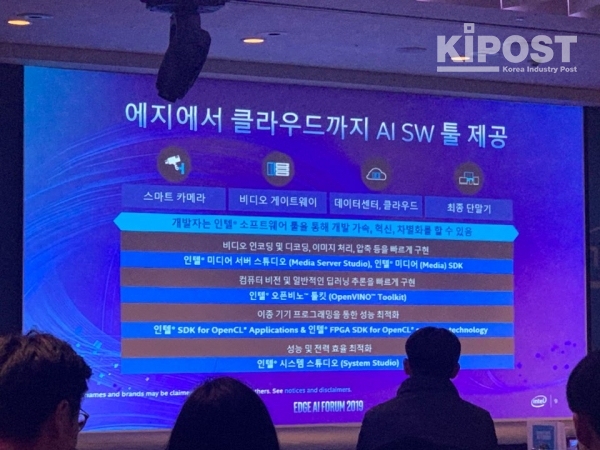

인텔은 소프트웨어 개발 도구로 ▲미디어 서버 스튜디오 ▲오픈비노(OpenVINO) 툴킷 ▲오픈CL ▲인텔 시스템 스튜디오 등 4가지를 마련했다. 각각 단말, 네트워크 게이트웨이, 데이터센터 및 클라우드, 최종 단말에 쓰인다.

이 중에서는 신경망(NN) 추론 기능을 최적화해주는 오픈비노가 핵심이다. 오픈비노를 활용하면 CPU부터 프로그래머블반도체(FPGA)에 이르기까지 단 한 번의 프로그래밍으로 인텔의 모든 제품에 AI 추론 기능을 더할 수 있다.

개발 기간을 줄일 수 있는데다 서버까지 가지고 있는 업체들이라면 마다할 이유가 없다. 단말, 게이트웨이, 서버 등 일일이 기기에 맞춰 프로그래밍을 하기에는 시간과 비용 부담이 크다.

정석원 한화테크윈 기술개발센터장(상무)는 “우리가 인텔을 택한 이유는 인텔의 SoC 개발 능력과 오픈비노 때문”이라며 “특히 오픈비노는 개발 업체 입장에서 아주 유용한 툴”이라고 설명했다.

권명숙 인텔코리아 대표는 “엣지 AI에서 가장 중요한 건 생태계”라며 “시제품 개발부터 제품 출시까지 파트너 업체들을 위한 협력 모델을 구축했다”고 말했다.