최근 자동차 시장의 가장 뚜렷한 변화의 두 축은 ‘전기차’와 ‘자율주행’이다. 2차전지를 중심으로 긴 후방 생태계가 구축된 전기차와 달리 자율주행 분야는 소프트웨어와 반도체 업종 대기업들이 트렌드를 이끌고 있다.

그렇다면 자율주행 자동차 시장에서 중소⋅중견기업들은 계속 소외될 수 밖에 없을까. 중소⋅중견 기업이 자율주행 자동차 시장에서 파고들 수 있는 ‘틈새’에는 어떤 것이 있을까. KIPOST가 들여다봤다.

[자율주행, 틈새를 찾아서②] 프로세서, '+@'를 찾다

차량 내 프로세서는 ADAS용 프로세서와 인포테인먼트용 프로세서로 구분할 수 있다.

ADAS용 프로세서는 중앙에서 센서 정보를 융합, 분석해 각 ECU에 명령을 내린다. 자율주행의 ‘두뇌’인 만큼 인공지능(AI) 알고리즘을 구현할 수 있을 정도로 고성능이어야 한다.

향후에는 ADAS 프로세서가 인포테인먼트 시스템도 흡수할 것이라는 시각이 지배적이지만 ADAS 플랫폼의 개발 기간을 감안하면 당분간은 두 플랫폼이 별도로 진보할 것으로 보인다.

AI 더해지는 ADAS 프로세서

현재 세계 ADAS 프로세서의 70% 가량을 점유하고 있는 회사는 모빌아이다. 모빌아이의 시스템온칩(SoC) ‘아이큐(EyeQ)’는 비전 인식을 기반으로 전방 충돌 경고, 보행자 충돌 경고, 차선이탈 경고, 지능형 전조등 제어, 속도제한 표시 등의 기능을 제공한다.

아이큐에는 칩 내 코어들이 하나의 메모리를 공유하면서 데이터 입출력 및 처리 등의 연산 작업을 나눠 맡게 하는 이기종아키텍처(HSA)가 적용됐다. HSA를 통해 머신러닝 등의 연산은 내장된 가속화 코어에서 전담한다.

하지만 머신러닝보다 고도화된 AI 알고리즘을 구현하거나 인포테인먼트 시스템을 가동하기엔 아직 부족하다. 완성차(OEM) 업계가 엔비디아에 주목하는 이유다.

업계에 따르면 완성차 업체들은 1차 부품 협력업계에 엔비디아의 ‘드라이브(DRIVE) PX2’와 비슷하거나 그 이상의 성능을 확보한 ADAS 플랫폼에 대한 제안요청서(RFP)를 보낸 상태다.

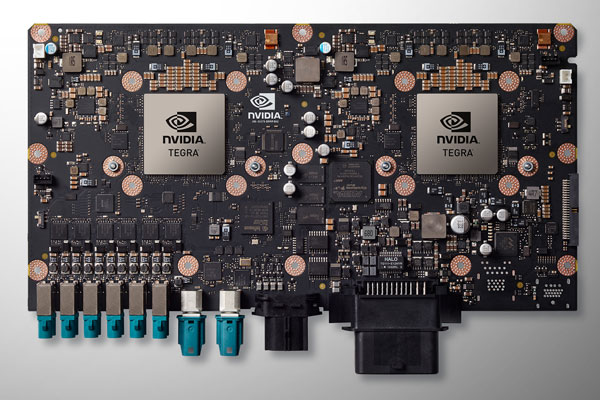

‘드라이브 PX2’는 엔비디아가 지난 2016년 선보인 AI 자율주행 플랫폼이다. ‘테그라 파커(Tegra Parker)’ 프로세서 2개와 파스칼(Pascal) 아키텍처 기반 GPU 2개가 탑재됐다. 딥러닝 연산 기준 20TOPS(trillion operations per second)의 성능을 자랑한다.

각 부품사들은 완성차 업체의 요청에 따라 드라이브 PX2를 기반으로 ADAS 플랫폼을 개발하고 있다.

문제는 전력 소모량이다. 드라이브 PX2의 전력 소모량은 80W에 달한다. 내부 테그라 파커 프로세서의 전력 소모량도 10W 수준으로, 모빌아이의 최신작 아이큐(EyeQ)4의 전력 소모량(3~5W)보다 2배 이상 많다.

업계 관계자는 “실제 전기차에 엔비디아 드라이브PX2를 탑재하고 시동을 걸었더니 얼마 지나지 않아 배터리가 다 닳아버리는 웃지 못할 상황이 벌어지기도 했다”며 “소프트웨어로 전력소모량을 최적화하는 작업을 진행 중”이라고 설명했다.

때문에 업계에서는 모빌아이와 엔비디아 사이에서 국내 업체들이 틈새 시장을 개척할 수 있으리라 전망한다. 코어 아키텍처를 바꾸거나 기존 시장에 뛰어드는 대신 AI 연산속도를 높일 수 있는 신경망처리유닛(NPU)이 유용하게 쓰일 수 있다고 내다본다. 국내 반도체 설계(팹리스) 기업 넥셀이 NPU ‘셀(XELL)’을 개발 중이다.

업계 관계자는 “ADAS 프로세서는 실시간으로 차량 내외의 정보를 인식, 처리해야해 연산 속도가 가장 중요하다”며 “폰 노이만 설계구조(아키텍처)에서 벗어나 새로운 아키텍처를 기반으로 한 뉴로모픽 프로세서의 가능성도 높지만 국내 중소기업이 하기엔 힘들다”고 설명했다.

현재 이보다 성능이 뛰어난 제품은 엔비디아가 최근 발표한 시스템온칩(SoC) ‘자비에(Xavier)’다. 자비에는 20W의 전력을 소모하면서도 딥러닝 성능은 드라이브PX2와 같은 수준이다. 엔비디아는 올해 이 제품의 샘플을 각 고객사에 공급할 예정이다

신기능·신기술 도입되는 인포테인먼트

인포테인먼트 프로세서도 칩 내 GPU 성능을 높이는 방식으로 연구개발(R&D)이 이뤄지고 있다. 차량 헤드유닛에 있는 헤드업디스플레이(HUD)나 계기판 등을 제어하는 영역이 늘어나면서 처리해야하는 이미지 정보의 양이 증가하고 있기 때문이다.

이장규 텔레칩스 대표는 “스마트폰용 애플리케이션프로세서(AP)와 마찬가지로 차량용 인포테인먼트 프로세서도 칩 내에서 GPU가 차지하는 비중(Block)이 CPU보다 크다”며 “향후 가상현실(VR), 증강현실(AR) 등을 구동하기 위해서는 특히 GPU의 역할이 중요하다”고 설명했다.

비슷한 맥락에서 차량에 내장되는 컴바이너(Combiner) 타입 UHD는 마이크로LED가 활용될 가능성이 점쳐진다. LCD나 유기발광다이오드(OLED)와 달리 저온·고온에 유리하고 휘도도 높기 때문이다.

김영우 한국광기술원 마이크로LED연구센터 박사는 “현재 HUD의 가장 큰 문제는 디스플레이의 수명과 시인성”이라며 “마이크로LED는 LCD, OLED보다 명암비도 높고 응답시간도 빠르다”고 말했다.

한편 부품업계에서는 센서로 편의성을 높일 수 있는 각종 기능을 구현하는 방안을 고민하고 있다.

이를테면 운전석 앞에 카메라와 라이다 센서를 적용, 눈동자의 움직임을 인식해 운전자의 졸음 운전을 방지하는 동시에 운전자의 시야를 따라 인포테인먼트 시스템의 화면 밝기를 조정해주는 식이다.

지문인식센서를 활용, 차량 내 탑승자를 파악하고 그에 맞춰 등받이 위치나 의자 위치를 조정하는 기능도 검토 중이다.

업계 관계자는 “음성 및 이미지 신호 처리 기술이나 센서 제조 기술을 가진 업체에게 기회가 있을 것”이라며 “3D 그래픽 처리 기술도 UHD 등에 활용될 수 있을 것”이라 내다봤다.